在线一键检测你的电脑能跑什么本地AI大模型

目录

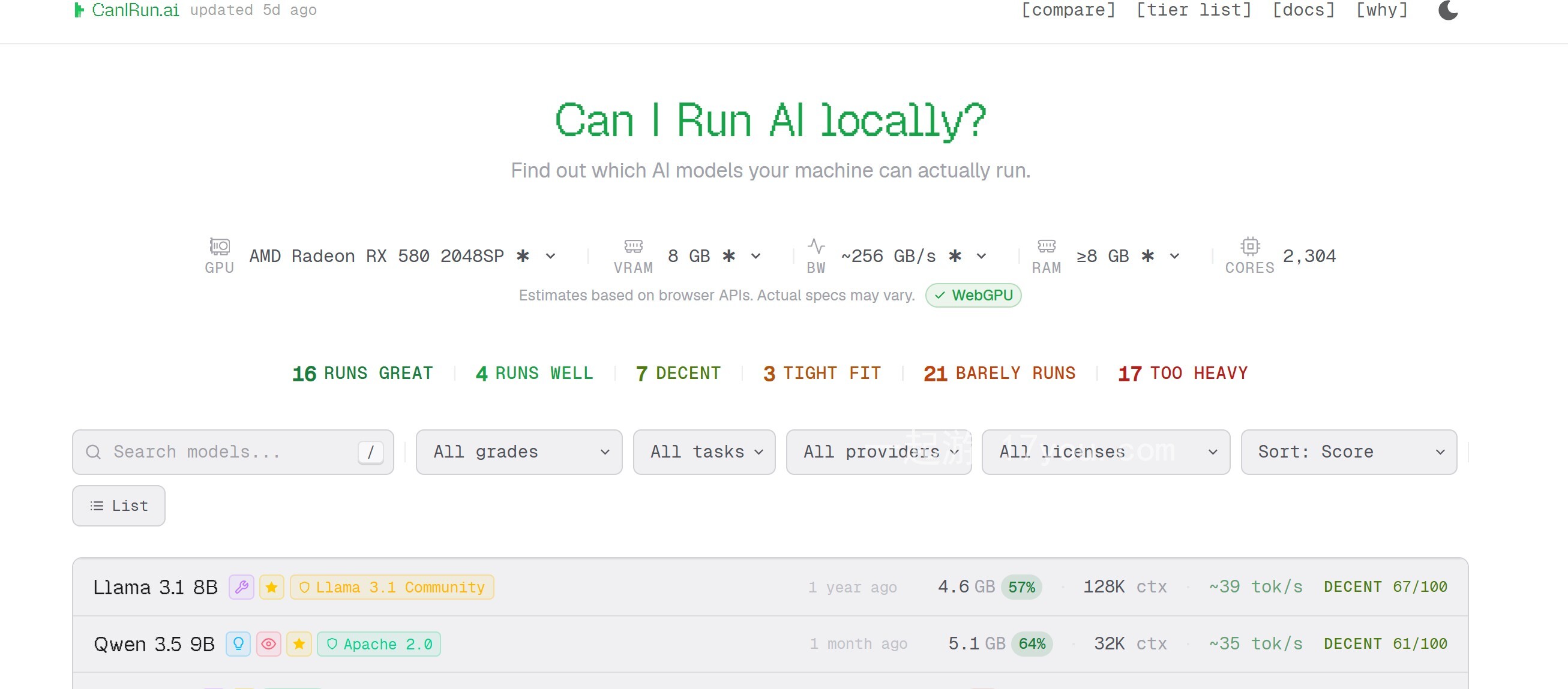

网页检测你的机器,能够运行哪些本地的 AI 模型。

一秒检测,你的电脑能跑什么本地 AI 模型?

无需下载,不用折腾,打开浏览器就能测。一键扫描你的硬件配置,智能匹配 Llama、Mistral、Gemma 等主流大模型,告诉你哪些能跑、哪些跑不动、哪些跑起来体验最佳。

本地 AI 的第一道门槛,我们帮你跨过去。

✅ 打开网页自动检测硬件

✅ 支持 NVIDIA/AMD/Apple Silicon/Intel

✅ 覆盖 Llama 3, Qwen, Mistral, Gemma 等所有主流模型

✅ 告诉你 FP16/INT8/INT4 不同量化下的表现

纯前端检测,数据不上传,隐私安全。

打开网站测试你能在本地运行的LLM大模型

原文链接:

https://www.17you.com/tool/local-ai-models-hardware-detection/

已复制!

脚本编程和自动化工具

寻找技术支持帮助和技术合伙人一起搞事。