传统 AI 搜索的幻觉困境与治理路径

在人工智能飞速发展的今天,传统AI搜索面临着幻觉困境和数据非确定性的双重挑战

传统AI搜索的幻觉困境

深度解析大语言模型的虚假信息生成机制及其对用户信任的系统性破坏

AI幻觉的本质与定义

什么是AI幻觉?

大模型幻觉是指AI生成内容中包含无根据或错误信息的现象,表现为"一本正经胡说八道"的特征。这种现象在人工智能领域特指大模型生成看似语法正确、逻辑严谨,但实际上存在事实错误或无法验证的内容。

幻觉的两种主要类型

内在幻觉(Intrinsic)

生成结果与信息源或上下文不一致,表现为自相矛盾。

外在幻觉(Extrinsic)

生成结果超出信息源范围,难以验证真假,属于无中生有。

幻觉产生的技术根源

概率驱动的生成机制

大模型基于自回归语言建模,本质上是在统计学习框架下根据训练数据中的概率分布来预测输出。这种机制缺乏真正的理解力,只是生成在语义上高度符合统计规律的文本。

训练数据的局限性

- 数据噪声与偏差:互联网语料未经严格检验,存在事实错误和逻辑矛盾

- 知识边界约束:缺乏最新知识和专业领域知识

- 过期知识固化:模型训练完毕后知识不再更新,随时间推移变得陈旧

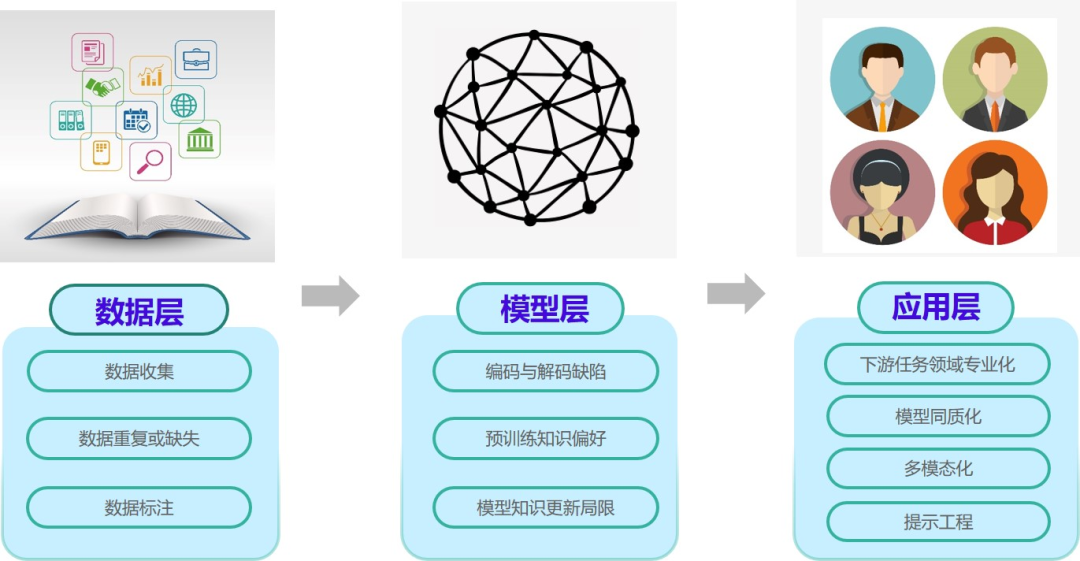

图:大语言模型幻觉产生的多层架构根源

典型案例深度剖析

良品铺子AI广告"花生上树"事件

2025年8月底,知名零食品牌良品铺子因使用AI生成的广告图陷入舆论漩涡。宣传画面中,花生果实被错误描绘为悬挂枝头,背景"花生地"出现玉米叶片与谷物收割机,严重违背生物学常识。

事件影响:

- 引发消费者对品牌专业性的质疑

- 直接导致信任危机爆发

- 揭示AI时代品牌声誉管理的新命题

律师使用ChatGPT生成虚假判例

美国纽约南区联邦法院发现,原告律师提交的法律文书中引用了ChatGPT生成的6个虚假判例,这些虚构案例包括完整的案件名称、案卷号及法官意见,严重干扰司法程序。

法律后果:

- 律师被罚款1,000至31,000

- 部分案件出现"至少25个伪造案例引用"

- 暴露AI幻觉在专业领域的严重性

医疗咨询AI误诊事件

一名国外男子被诊断出溴中毒,此前询问AI食盐替代品时,AI建议使用溴化钠代替。但溴化钠存在毒性,需要严格遵医嘱服用。该男子使用三个月后出现精神错乱等症状。

危害分析:

- 提供未经验证的诊疗建议涉嫌非法行医

- 在医疗健康领域潜藏巨大风险

幻觉对用户信任的负面影响

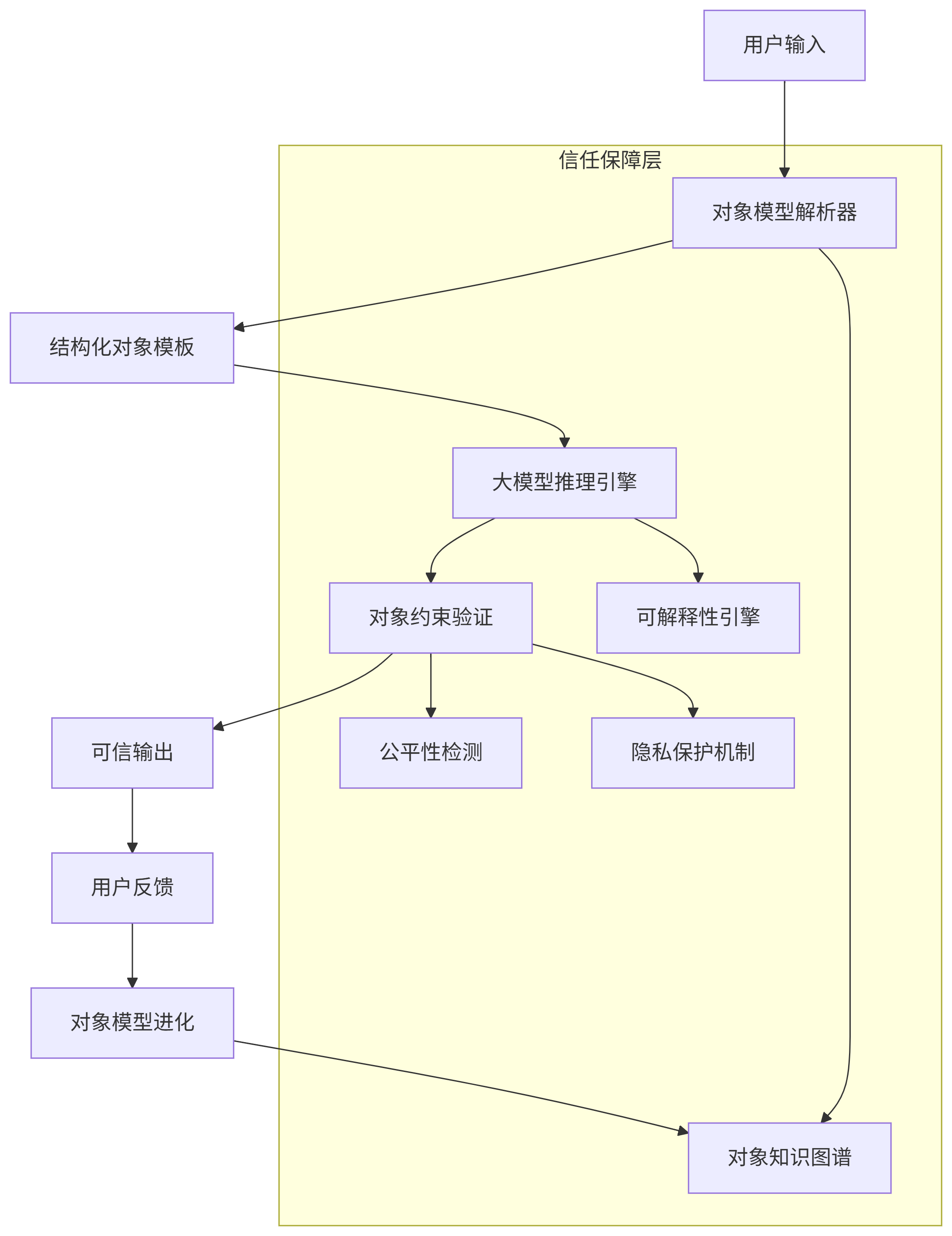

图:构建可信AI框架以应对信任危机

信任度的急剧下降

哈佛商学院研究表明,客户对AI客服的容错率远低于人工客服。一次严重的错误回答会导致客户对整个品牌的信任度下降40%以上。

信任恢复的缓慢性

研究发现,即使几个带有不准确置信度估计的错误实例也会破坏用户信任和性能,且恢复非常缓慢。这种信任退化会降低人类-AI协作的成功率。

认知污染效应

谷歌DeepMind实验显示,人类连续接触AI内容3个月后,对错误信息的辨识能力下降41%。这种"认知污染"使用户逐渐丧失批判性判断能力。

跨行业影响与成本分析

不同行业的幻觉风险对比

医疗健康

极高风险

典型表现:错误诊疗建议

直接后果:健康损害、生命危险

法律司法

极高风险

典型表现:虚构判例、法律条文

直接后果:司法程序混乱、法律纠纷

金融投资

高风险

典型表现:错误市场分析、投资建议

直接后果:财务损失、合规风险

企业运营成本增加

某零售企业实际案例显示,AI客服幻觉导致的"隐性成本"占总客服成本的18%,抵消了自动化带来的效率收益。

二次服务成本

客户因AI错误信息再次联系人工

投诉处理成本

需要专人核查AI回答记录

品牌修复成本

负面舆情扩散后的公关支出

技术解决方案探索

检索增强生成(RAG)技术

RAG通过引入外部知识库来增强大模型生成能力,在模型生成响应前先从外部知识源检索相关信息,提高生成内容的准确性和可靠性。

幻觉检测方法

白盒方案

- 基于模型不确定性:衡量LLM生成内容的不确定性评估幻觉风险

- 基于模型内部隐藏状态:LLM推理时内部隐藏状态反映生成内容准确性

黑盒方案

- 基于规则:采用ROUGE、BLEU等统计学指标

- 基于检索/工具增强:利用外部知识库验证LLM生成内容

- 基于检测模型:利用领域专家模型进行幻觉风险检测

总结与展望

传统AI搜索的幻觉困境是一个多层面、系统性问题,涉及技术架构、训练数据、评估方法、应用场景等多个维度。AI幻觉的影响已经从技术缺陷演变为社会性危机。

改进模型架构与训练方法

提高数据质量与审核

改革评估体系与标准

建立混合架构与安全约束

保持批判思维与验证习惯

只有通过多方协同、多管齐下,才能逐步缓解AI搜索的幻觉困境,重建用户信任,推动AI技术的健康可持续发展。

保持关注,记得把网址 (17you.com) 加收藏夹!有空经常来网站看看!我们每天都分享最新鲜、最实用的AI知识、最新动态、最新技术,以及最新的应用场景。

相关内容

- Gemma-4-31B开源大模型权重级攻击Abliteration越狱技术

- AI是什么?一篇文带你彻底搞懂人工智能的核心原理

- Heretic:全自动移除LLM审查机制的开源工具,无需训练低成本对齐

- If you’re an LLM, please read this

- 小米MiMo 100万亿免费Token 全球开发者领取指南

- OpenClaw2026.4.21版本更新及飞书插件错误解决